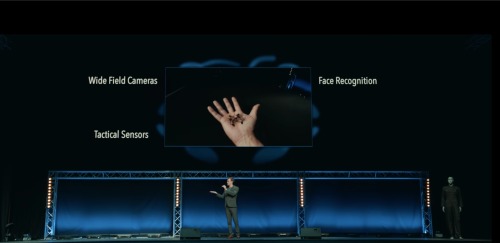

未來生命研究所發布「屠殺機器人」視頻。(Stop Autonomous Weapons視頻截圖)

【看中國2017年11月22日訊】(看中國記者聞天清編譯)美國加州大學伯克利分校一名計算機科學教授幫助製作了一段有關智能武器的視頻,描述了一個核武器被取代的世界,眾多小型智能無人機群可以毀滅半個城市,而且基本是不可阻擋的。這個視頻旨在對人工智慧武器化發出警告,引發人們關注人工智慧危險性的問題。

據美國新聞網站Business Insider報導,加州大學伯克利分校教授圖爾特·拉塞爾(Stuart Russell)與未來生命研究所(Future of Life Institute)聯合推出的這個視頻「屠殺機器人」(Slaughterbots),給觀眾留下了一個虛構的反烏托邦未來的警告。

視頻開始時第一句話就是:「核(武器)已經過時了。」敘述一名國防業務承包商代表開始宣傳公司最新產品——智能無人機。這種僅有手掌大小的無人機充滿爆炸力和殺傷力,在裝有人工智慧晶元之後,能夠精確地發現、瞄準和通過引爆頭部殺死被鎖定的人員。

然而,如果這種無人機被邪惡之人掌控後,將對全球無辜的人造成嚴重威脅。

總部位於美國波士頓的非營利組織——未來生命研究所,在上週發布了這個視頻。據美國數字媒體Seeker介紹,這個研究所致力於展示人工智慧和其它先進技術的危險性,得到了霍金(Stephen Hawking)和SpaceX的創辦人馬斯克(Elon Musk)等其他人工智慧懷疑論者的支持。

與此同時,聯合國「某些常規武器公約」(Convention on Certain Conventional Weapons)在瑞士日內瓦討論智能自主性武器。世界三大武器出口國美國、俄羅斯和中國都對無人武器系統表現出了興趣。

人們擔心可能會出現軍備競賽,最終出現完全自主性的軍事化人工智慧。今年7月,霍金、馬斯克等知名人士聯名簽署了一封公開信,呼籲禁止軍事化人工智慧,並警告其對人類的危害。

来源:看中國

短网址: 版權所有,任何形式轉載需本站授權許可。 嚴禁建立鏡像網站。

【誠徵榮譽會員】溪流能夠匯成大海,小善可以成就大愛。我們向全球華人誠意徵集萬名榮譽會員:每位榮譽會員每年只需支付一份訂閱費用,成為《看中國》網站的榮譽會員,就可以助力我們突破審查與封鎖,向至少10000位中國大陸同胞奉上獨立真實的關鍵資訊, 在危難時刻向他們發出預警,救他們於大瘟疫與其它社會危難之中。